Background

假新聞是指故意捏造、篡改或散播虛假訊息的新聞。產生的主要因素包括:網路傳播的普及、社群媒體的興起、點擊率和廣告收入、政治或經濟動機。

解決假新聞問題需要綜合多方面的努力,包括:技術手段、教育提升媒體素養,以及社會對真實性的關注。

假新聞與人工智慧(AI)之間存在一定的相互影響, AI 也被應用於檢測和對抗假新聞。

機器學習算法可以分析大量數據,辨識模式,並識別可能的虛假訊息。然而這場「技術戰爭」也在不斷升級,假新聞製作技巧不斷進步,迫使檢測方法不斷更新。

Transformer Model

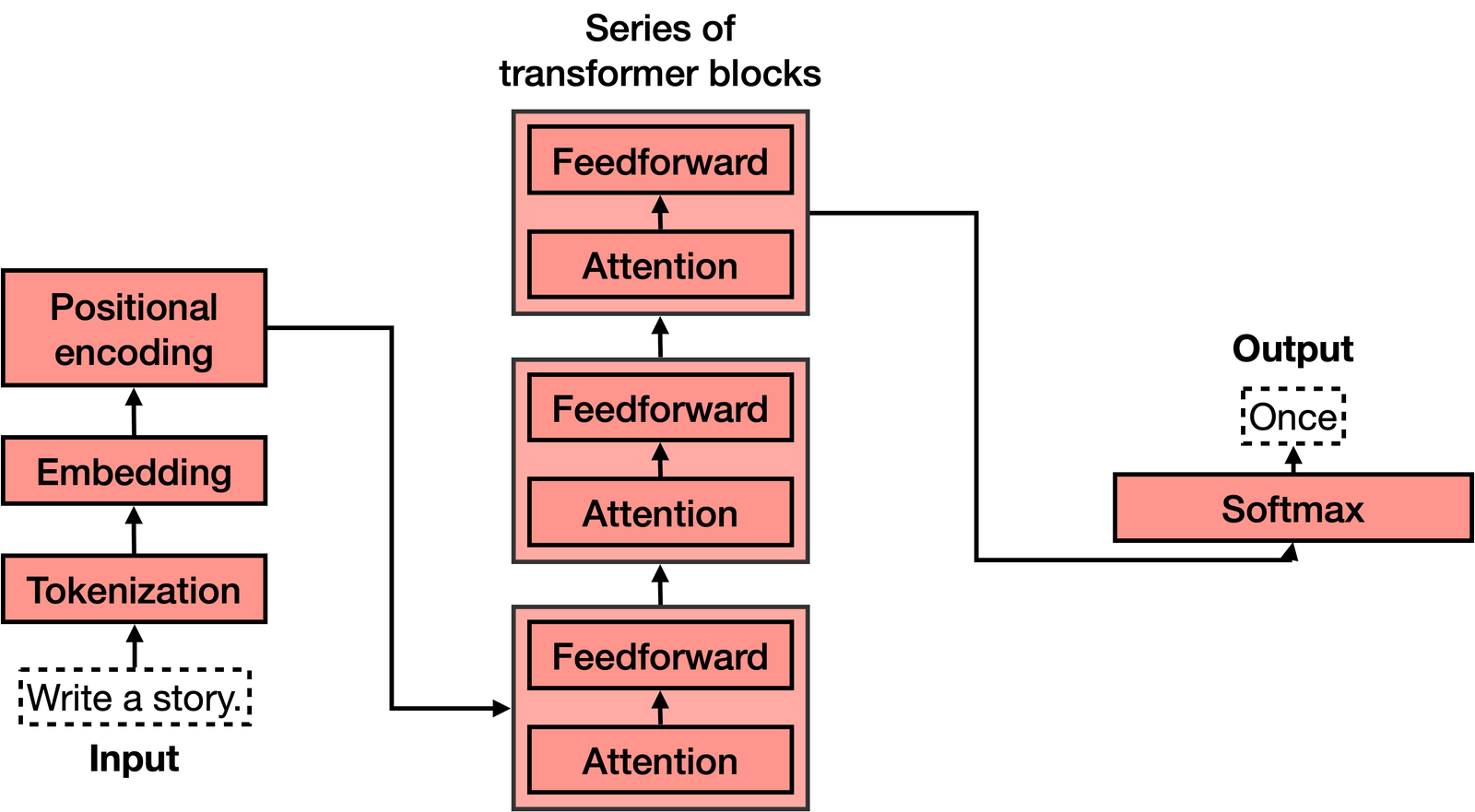

Transformer模型由多個模組組成,每個模組都有著特定的功能,並共同協作以理解文本並生成下一個單詞。以下是這些模組的簡要介紹:

- Tokenization(分詞):將文本中的字詞轉化為標記(tokens),以便模型能夠處理和理解它們。

- Embedding(嵌入):將標記轉化為數字(向量)表示形式,使得模型可以對其進行計算和處理。嵌入將每個標記映射到一個高維向量空間中,捕捉字詞之間的語義關係。

- Positional encoding(位置編碼):為文本中的每個字詞添加順序訊息,解決單詞順序對於模型的重要性。通過位置編碼,模型能夠區分不同單詞在向子中的位置,從而更好地理解上下文關係。

- Transformer block(變換器塊):是 Transformer 模型的核心組件,由一個注意力塊和一個前饋塊組成。

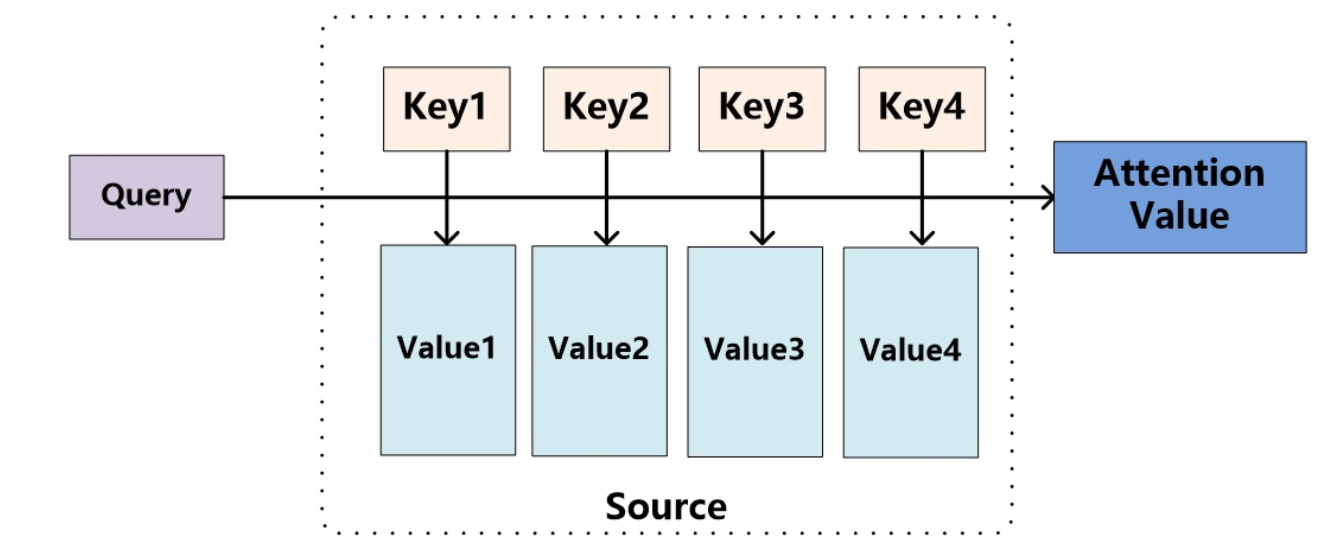

- Attention(注意力塊):用於為文本添加上下文內容,捕捉不同單詞之間的依賴關係。

- Feedforward(前饋網絡):則用於對注意力塊的輸出進行進一步的非線性變換,以產生對下一個單詞的預測。

- Softmax(歸一層):將模型預測的分數轉化為概率分布,以便進行下一個字詞的採樣。通過對分數進行歸一化,Softmax 層將其轉化為概率值,使得模型能夠選擇概率最高的單詞作為預測輸出。

Attention 為模型的核心,它的主要功能為判斷每個詞在段落中的意思。同一個詞可能有不同的含意,像是 bank 有銀行和河堤的意思,這個情況 Attention 就能幫助模型從上下文中判斷是何意義。而 Transformer 中使用的為多頭注意力(Multi-Head Attention),它使用了多種不同的嵌入去修改向量並添加上下文。簡單來說就是同時有多個注意力執行,並將結果合併起來。

Feedfoward 不同於 Attention 使用矩陣的線性變化,是用非線形變換,因為非線性變換的學習能力較線性變換強。它在每次變換時都引入非線性激勵函數 Reul,將數據從高緯度的空間引入低緯度的空間,提取更深層的特徵。簡單來說,就是為 Attention 所得到的 values 來提取更仔細的內容。

Transformer 模型流程圖

Attention 流程圖

Example

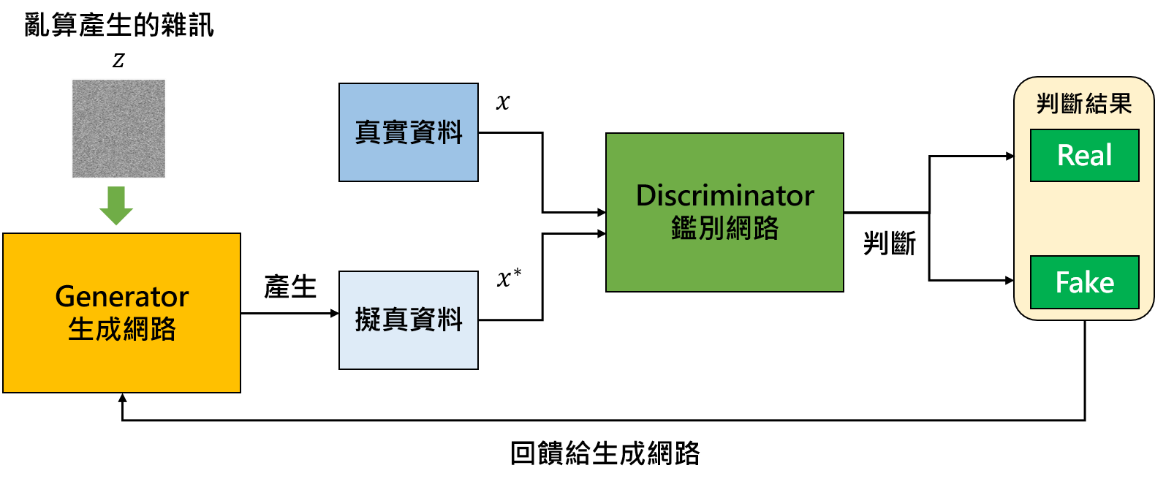

Grover 從 Google 新聞上5,000個不同媒體撰寫的新聞中進行學習。為提升假新聞辨識準確度,運用到生成對抗網路(GAN)技術,在此技術的運作下,最終 Grover 分辨人和 AI 寫的故事的正確率是92%。在此之前,最好的假新聞辨識器的正確率是73%。

限制

Grover 仍有8%的假新聞無法分辨。

可能解法

提供更多樣本,並加強訓練時間,以提高 AI 的辨識率。

風險

Grover 在 GAN 技術的運作下,除了訓練出辨認假訊息的 AI 外,還訓練了生成假新聞的 AI ,若後者被有心人所利用,將對現今的資訊社會產生風險。

生成對抗網路(GAN)的架構